AI配音的演进:从TTS到生成式音频

AI配音正从简单的文本转语音(TTS)演变为能实时克隆音色并模拟情绪的生成式音频。到2026年3月,这项技术已在商业培训、独立游戏开发和内容创作中成为标准配置。

AI配音的实质突破在于解决了声音的“可编辑性”。 传统录音中,修改一个词意味着需要重新预约演员、搭建棚室并录制;而现在,修改一个字符并点击生成,音频即可在1秒内更新。这种生产链路的改变,将数字化内容的迭代效率提升了数个量级。

其技术底层逻辑分为三个阶段:首先是文本分析,AI将文字转化为音素(Phoneme),通过语法结构分析确定停顿与升调;其次是声学模型生成,将音素映射到频谱图(Spectrogram)以决定频率和振幅;最后由声码器(Vocoder)将频谱图还原为波形文件。目前的顶尖产品主要基于扩散模型(Diffusion Models)和Transformer架构。

“零样本克隆”(Zero-Shot Cloning)是目前的前沿方向。 AI不再需要数百小时的样本训练,仅凭3-5秒的清晰音频即可捕捉说话者的基频、共振峰和口癖。这让独立开发者获得了极低成本的配音能力,但也压缩了初级配音演员的市场空间。

主流AI配音工具的选择与对比

用户在选择工具时,需要在自然度、成本与掌控力之间进行权衡。不同类型的工具适用于不同的业务场景。

| 工具类型 | 代表产品 | 核心优势 | 适用场景 | 成本模式 |

|---|---|---|---|---|

| 高端商业级 | WellSaid Labs | 企业级稳定性、极高自然度 | 内部培训、产品演示 | 高额订阅制 |

| 创意生成类 | ElevenLabs | 强情绪表达(愤怒/低语) | 视觉小说、短剧 | 按字符计费 |

| 开源模型类 | GPT-SoVITS / Fish Speech | 高度灵活、隐私可控 | 本地化部署、极客创作 | 硬件成本(显卡) |

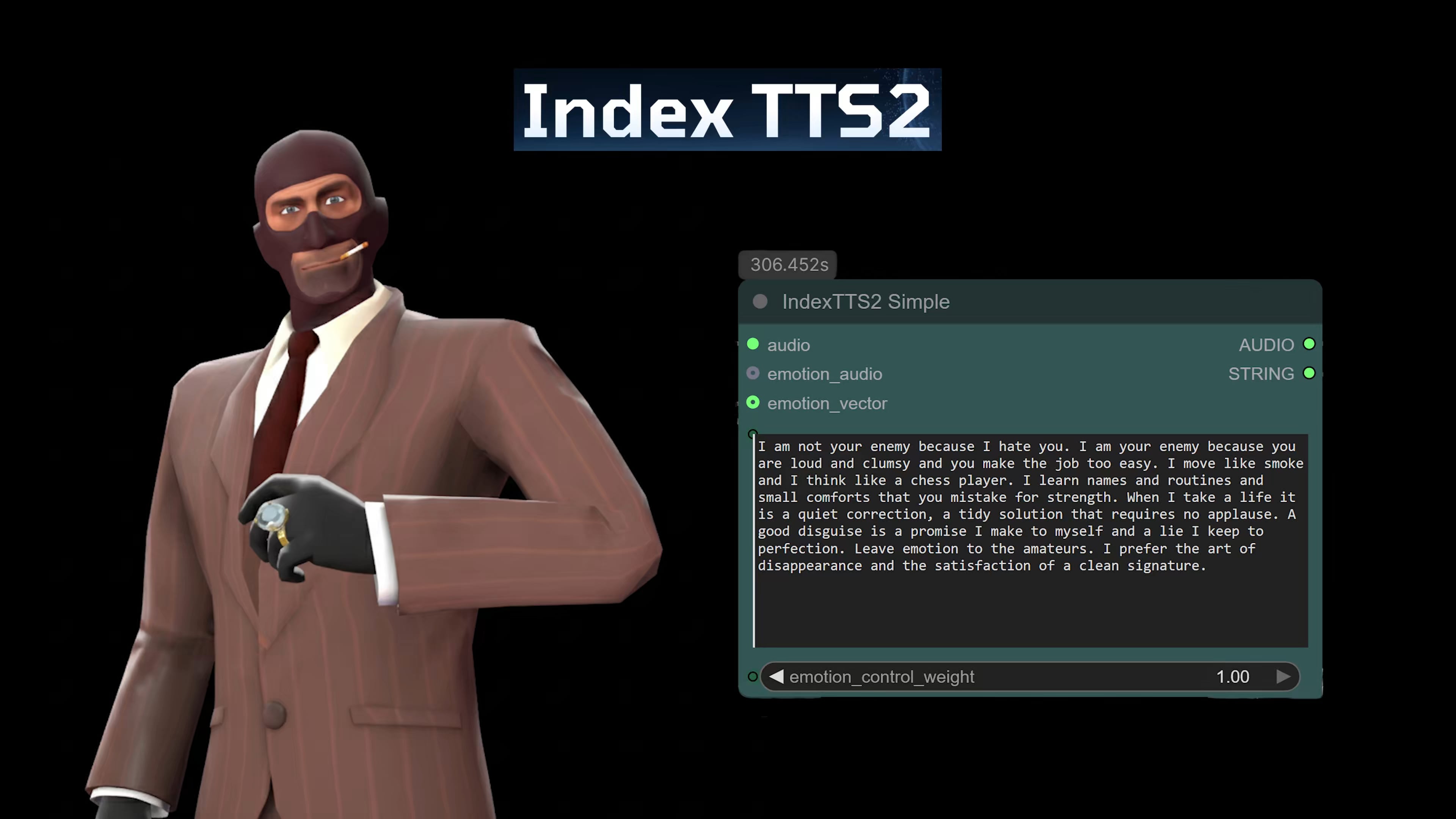

对于技术人员,GPT-SoVITS 或 Fish Speech 等开源模型是更灵活的选择。配合 RTX 4090 等高性能显卡可实现本地化部署,在消除订阅费的同时解决了隐私泄露风险。

短视频场景下的 AI 配音实操指南

为了获得最自然的听感,建议避免直接将书面文本输入 AI,而应采用以下标准工作流:

AI 配音的局限性与应对策略

尽管技术飞速发展,但在高精度要求场景下,AI 仍存在明显短板:

首先是高情感密度的戏剧表演。 AI 模拟的是概率分布下的波形,无法理解剧本潜台词。在高端影视剧中,这种缺乏灵魂的模拟易产生“恐怖谷”效应,被观众识破。

其次是极小众方言或高精度专业领域。 面对深层方言俚语或生僻工业术语,AI 易出现读音偏差。在医疗手术指导等容错率极低的场景,读音错误可能导致严重误解。

最后是版权与伦理风险。 许多免费工具的商用权利模糊。若未经授权克隆名人声音,在 2026 年的法律环境下极易引发纠纷。商用场景应优先选择拥有完整版权库的平台。

核心建议:采用“AI 粗加工 + 人类精修”的协作模式。 80% 的信息传递类内容由 AI 生成,20% 的核心情感片段由专业配音员录制,最后进行融合。这样既能控制预算,又能保证作品的艺术上限。

Q: 为什么 AI 配音在某些段落听起来很奇怪?

这通常是因为文本过于书面化或标点符号缺失导致 AI 无法正确判断断句和升降调。尝试将文字修改为口语,并在停顿处增加逗号即可改善。

Q: 稳定性(Stability)和相似度(Similarity)参数如何取舍?

追求稳重、统一的播报感时,提高稳定性(建议 70%);追求极高还原度和情感波动时,降低稳定性并提高相似度(建议稳定性 40%,相似度 80%)。