从概率生成到工业级控制:AI绘画的进化逻辑

AI绘画已从早期的像素随机生成演变为基于潜空间(Latent Space)的概率分布预测。到2026年,这门技术不再局限于生成单张图片,而是一套集成精准控制、动态迭代和多模态交互的工业化生产管线。

AI绘画正经历从“随机抽卡”到“精准手术”的进化。

早期Midjourney或Stable Diffusion虽能制造视觉奇观,但无法控制手指数量或光影逻辑,导致专业创作者难以将其用于商业交付。随着ControlNet的深度集成与分层潜空间编辑技术的普及,用户可以像操作Photoshop图层一样指定像素走向。这意味着AI绘画正从概率游戏转变为可量化的生产工具。

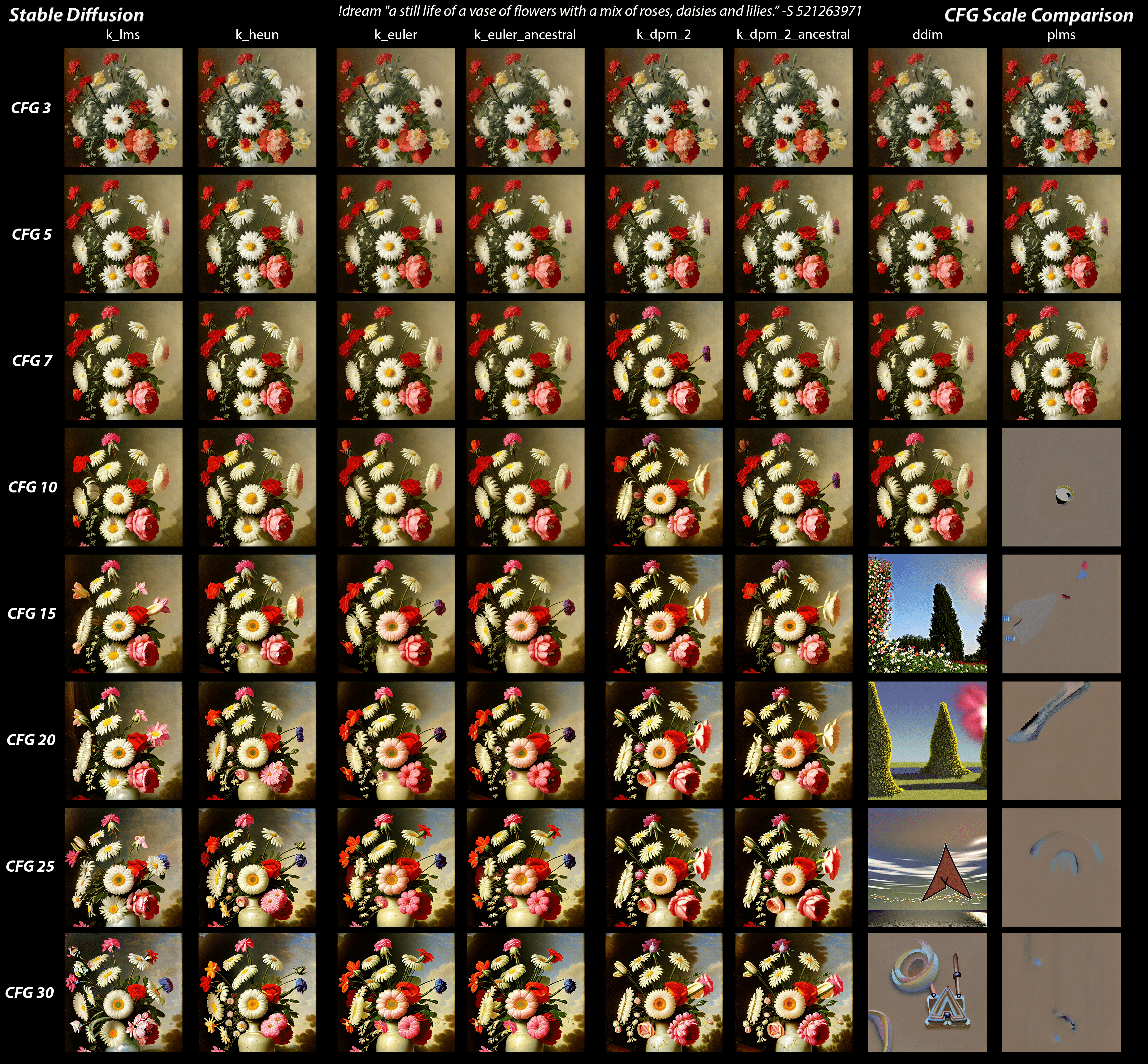

其底层逻辑基于扩散模型(Diffusion Model),分为前向扩散和反向去噪两个阶段。训练时,模型向图像中加入随机噪声直至其变为杂讯;生成时,模型根据提示词(Prompt)将噪声逐步剔除。本质上,这是一个条件概率预测过程:模型在计算给定文本条件下,某个像素点呈现特定颜色的最大概率。

构建高效的混合工作流:以 ComfyUI 为核心的实操指南

单纯掌握Prompt已触碰到能力天花板,真正的竞争力在于视觉语言的掌控力与模型参数的微调能力。目前行业核心竞争力已转移至“混合工作流”,即结合多种工具的组合链路。

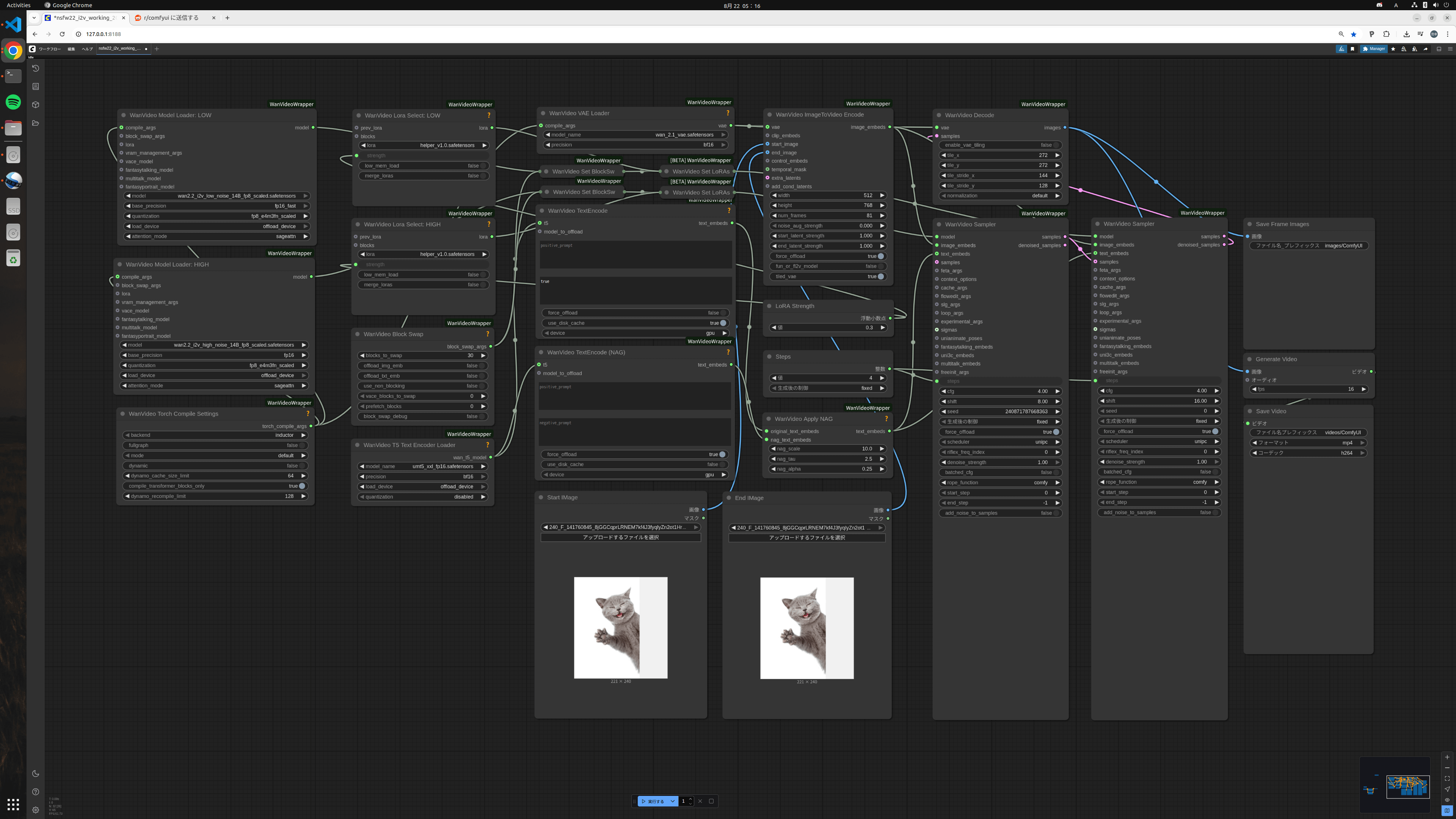

以本地部署的ComfyUI为例,其节点式编辑将加载模型、输入文本、采样去噪、解码图像等步骤可视化,实现了比简单输入框更高的控制精度。

第一步:环境搭建

--lowvram 以保证程序运行。

第二步:构建控制流

第三步:采样优化

第四步:细节精修

商业化交付的考量:局限性与工具选型

AI绘画在商业原画任务中具有压倒性速度优势,但这迫使创作者从“记录现实”转向“表达情感”。目前市场呈现两极分化:顶端是结合3D建模与后期合成的“全栈视觉艺术家”,底端是依赖单一指令的“操作员”。

尽管如此,AI绘画仍存在三大局限性:一是逻辑一致性(如复杂机械结构),二是品牌标识的像素级精准度,三是缺乏社会语境支撑的情感共鸣。

方案对比:Midjourney美感顶尖但属“黑盒”

| 工具 | 核心优势 | 劣势/门槛 | 适用场景 |

|---|---|---|---|

| Midjourney | 审美极高,出图迅速 | 黑盒操作,难以精准控制 | 灵感激发、快速原型 |

| Stable Diffusion | 控制力强,生态丰富 | 学习曲线陡峭,硬件要求高 | 专业生产、商业交付 |

| DALL-E 3 | 指令理解力极强 | 具有明显的“AI味” | 快速概念验证 |

如何打破 AI 生成图片的“同质化”美感?

AI擅长生成概率分布中的“平均美”。打破同质化的核心在于引入真实生活的错误细节,通过人工干预引入某种程度的“不完美”或非线性的视觉冲突感,从而建立个人风格的护城河。

对于初学者,建议的进阶路径是什么?

建议采取阶梯式学习:先用两周尝试 Midjourney 感知视觉可能性 $\rightarrow$ 花一个月部署 Stable Diffusion 尝试基础出图 $\rightarrow$ 深入学习 ComfyUI 节点流 $\rightarrow$ 尝试训练一个个人风格的 LoRA 模型,完成从执行者到定义者的转变。

总结:从执行者向“视觉导演”转型

面对技术浪潮,插画师可转型为“视觉导演”,采用“AI生成 $\rightarrow$ 人工筛选 $\rightarrow$ AI优化 $\rightarrow$ 人工定稿”的闭环,在不降低质量的前提下提升产出量。

未来的竞争力将不再取决于你能写出多么复杂的 Prompt,而在于你如何定义情绪、构建管线以及在 AI 的“平均美”之上叠加人类独特的洞察力。