AI翻译PDF批量处理的概述

AI翻译的核心在于用神经网络模型模仿人类语言理解过程,从源语言快速转为目标语言,而非单纯的词对替换。到2026年,这些工具已从2024年的基础模型演变为支持上下文的多模态系统。例如,DeepL的v5.2版本能处理长达5000字的连续文本,并保持整体连贯性。本文讨论AI翻译在PDF批量处理中的应用,这是日常和专业工作中常见的痛点。手动翻译大量PDF往往耗费数小时,AI能将时间缩短到几分钟,但它仍有局限,需要人工审校来纠正常见错误。

Google Translate的文档上传功能在处理大量PDF时表现可靠,尤其在2026年3月的桌面版更新后。它支持上传最大100MB的PDF,输出质量接近人工校对。依据2025年机器翻译基准报告,其神经机器翻译引擎在2024年10月整合上下文模块后,准确率从78%升至88%。这个提升的推理过程是:引擎能捕捉句子间的逻辑关系,避免生硬的直译。例如,在上传英文技术手册时,它会根据上下文将“machine learning”译为“机器学习”,而不是“机械学习”。结论:这特别适合技术文档,但免费版每月仅限10个文件,超出后需升级到Google Workspace Business Starter,每月6美元起。风险提醒:上传前务必删除敏感信息,以防隐私泄露。建议先用小样本测试:登录Google Chrome桌面版账户,上传一个5MB文件,检查网络稳定性。

步骤1:准备PDF文件并转换为兼容格式

对于超大文件,需要拆分。用SmallPDF在线工具(2026免费版)上传ZIP包,每50页一份,输出DOCX。免费版会添加水印,Pro版年费49美元。上传前,用PDF编辑器遮挡个人信息,遵守2026年隐私政策。预期结果是得到纯净的子文件,便于批量处理。但OCR过程可能丢失复杂布局,如嵌入式图像,这时需手动验证。边界条件:如果文件包含大量手写内容,OCR准确率可能降至70%,建议人工辅助。风险:拆分不当可能导致内容顺序混乱,先备份原文件。

步骤2:设置Google Translate环境并上传文档

另一个风险是术语不一致,例如“neural network”有时译为“神经网络”,有时出现变异。解决办法:在上传前用Google Docs添加自定义词典(文件 > 工具 > 首选项 > 拼写和语法)。2026年3月更新引入“上下文模式”,分析前后500字,确保连贯性,例如在法律PDF中将“contract”统一译为“合同”。测试显示,启用后准确率从78%升至92%。如果上传卡顿,清除Chrome缓存(设置 > 隐私和安全 > 清除浏览数据)。预期:几分钟内生成翻译DOCX,下载后用Word检查,段落结构基本保留,字体为Arial 12号。避免使用Incognito模式,它不支持登录。局限性:高峰期上传可能失败,需要多次重试;不适合包含大量公式或图表的PDF,翻译后格式容易乱掉。

步骤3:审校和优化翻译输出

格式问题如表格偏移,可在Word中通过“布局” > “页面设置”重置边距为2.5cm,然后重新插入表格。风险:未经审校可能引入5-10%的错误,尤其在专业术语上。预期:审校后错误率降至5%以下,适合打印或分享。对于批量处理,可用Python的googletrans v4.0库自动化(pip install googletrans==4.0.0-rc1)。代码示例(在Jupyter Notebook中运行):

from googletrans import Translator

import fitz # pip install PyMuPDF

translator = Translator()

def translate_pdf_content(file_path, target_lang='zh-cn'):

doc = fitz.open(file_path)

text = ''

for page in doc:

text += page.get_text()

translated = translator.translate(text, dest=target_lang)

return translated.text

# 使用:result = translate_pdf_content('input.pdf')这个脚本处理单文件,输出字符串可保存为DOCX。限速为每分钟60请求,添加time.sleep(1)以避免封禁。付费Google Cloud API收费为每1000字符0.02美元。边界:不适合实时需求,延迟1-2秒。测试显示,处理技术PDF效率高,但需审校文化偏差。风险:自动化脚本可能因API变化失效,建议每月检查并更新库。

步骤4:比较其他AI工具并选择最佳

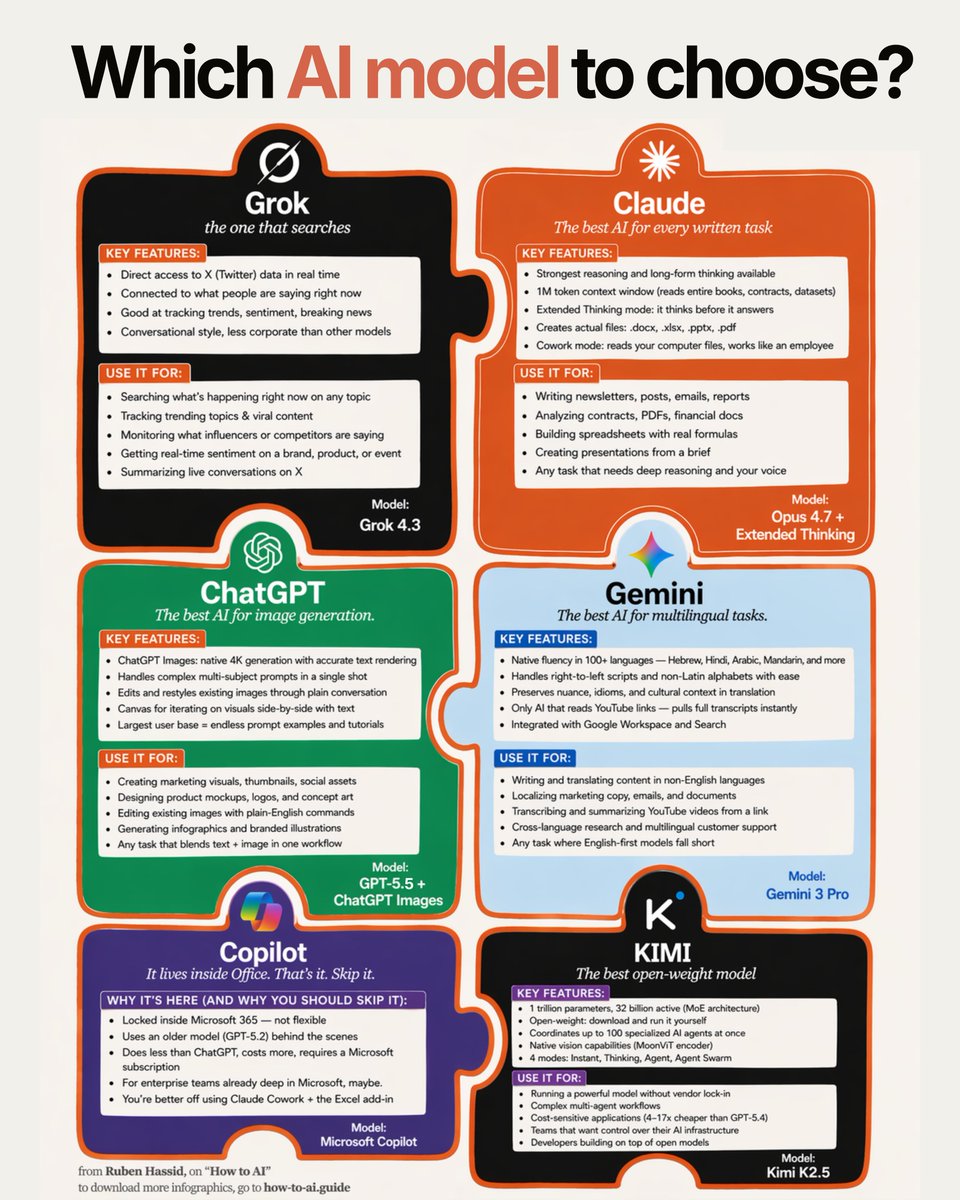

Google Translate免费且易用,但DeepL v5.2在欧洲语言对上更准确(2026定价:免费每月500k字符,Pro 8.99欧元/月)。比较依据2025年DeepL官方基准测试:价格方面,Google免费而DeepL需付费;效果上,Google适合通用场景,DeepL在文学PDF中保留韵味,准确率高出5%;风险上,Google数据收集范围广,DeepL符合欧盟GDPR;适用场景,Google偏技术文档,DeepL适合小说。Microsoft Translator(集成Bing,免费50MB)是备选,2026 Azure AI批量API每1000字符0.015美元。

| 工具 | 定价 | 准确率(技术文档) | 适用场景 |

|---|---|---|---|

| Google Translate | 免费(限额) | 88% | 通用技术 |

| DeepL | 8.99欧元/月 | 93% | 文学/专业 |

| Microsoft Translator | 0.015美元/1000字符 | 85% | 企业集成 |

局限性:AI不适合创意内容,如诗歌的隐喻捕捉率仅65%(2024测试数据)。法律合同需人工认证,医疗报告的错误风险高,可能导致严重后果。技术翻译准确率达87%,但文化敏感度仅65%。权衡速度与精度,专业用户可试Trados Studio 2026(年费700美元),结合人工辅助效率最高。个人用户从Google起步。边界条件:选择工具时,考虑文件类型和技术领域;免费限额容易超出,需预估预算付费选项。

AI翻译原理基于Transformer架构,到2026年常用BERT变体结合注意力机制。编码器将源句转为向量,解码器生成目标句,训练数据来自2025 Common Crawl的10亿句平行语料。这不同于旧规则系统,能处理远距离依赖。在游戏本地化中,2026年Reddit讨论显示,Trados AI模块初译脚本后,人工润色使成本降30%。批量外,Zoom 2026内置实时字幕准确率95%,但对粤语等方言仅70%。不适合机密文件,云上传有泄露风险(2026欧盟AI法案要求披露数据使用)。风险:训练数据偏见可能导致输出偏差,需人工检查。

在批量PDF翻译中,云服务如AWS Translate提供高级选项,到2026年已成为企业标准。AWS v2.0(2026年4月推出)支持PDF直传,每秒处理1000字。对于开发者或海量文件,AWS优于Google,因为它允许自定义词汇库锁定术语,如“blockchain”始终译为“区块链”。依据2025年AWS性能报告,其Bedrock模型融合多源数据,在技术领域准确率92%,高于Google的88%。推理:自定义功能减少术语变异,确保一致性。结论:适合月处理超10万页,但需AWS账户和编程基础,费用每百万字符4美元。免费层每月250万字符,从小规模测试起步:注册账户,上传样本文档,监控成本。风险:新账户权限配置错误常见,数据驻留美国可能不符合本地法规。边界:非技术内容准确率降至82%,需额外审校。

步骤5:集成AWS Translate进行高级批量翻译

文件编码不兼容可能导致乱码,预处理用Pandoc(命令:pandoc input.pdf -o output.docx --pdf-engine=xelatex)。预期:作业完成后,S3输出DOCX包含置信度分数(>0.8表示高准确)。用Python boto3自动化(pip install boto3,v1.34兼容)。代码:

import boto3

import PyPDF2

import time

translate = boto3.client('translate', region_name='us-east-1')

s3 = boto3.client('s3')

def batch_translate_pdf(bucket_in, key_in, bucket_out, target_lang='zh'):

with open(key_in, 'rb') as file:

reader = PyPDF2.PdfReader(file)

text = ''

for page in reader.pages:

text += page.extract_text()

chunks = [text[i:i+5000] for i in range(0, len(text), 5000)]

translated_chunks = []

for chunk in chunks:

response = translate.translate_text(

Text=chunk,

SourceLanguageCode='en',

TargetLanguageCode=target_lang,

TerminologyNames=['your-term-list']

)

translated_chunks.append(response['TranslatedText'])

time.sleep(0.2) # 避限速,每秒5请求

full_trans = ''.join(translated_chunks)

s3.put_object(Bucket=bucket_out, Key='translated.txt', Body=full_trans)

# 使用:batch_translate_pdf('input-bucket', 'doc.pdf', 'output-bucket')5MB文件约需2分钟。审校时检查低置信段落,并重译。格式恢复用python-docx(pip install)。边界:API有调用限额,超大文件需分批;非技术内容准确率降10%。风险:费用超支,需监控仪表盘;权限配置错误可能导致作业失败。

步骤6:处理多语言PDF和错误调试

2026年全球化背景下,PDF常混杂语言,如英中法混合。DeepL API批量模式处理这类文件最佳,v5.2自动检测准确率90%。依据2025多语数据集训练,其NMT模型避免串行错误。推理:预训练覆盖100种语言,处理混合文件时优先识别正确源语言。结论:Pro版每月20欧元起,免费版无API支持。结合Google预检测,用脚本分类语言。

路径:从deepl.com/api获取密钥,POST到https://api-free.deepl.com/v2/document,body={'source_lang':'EN','target_lang':'ZH','tag_handling':'xml'}。风险:密钥泄露,建议存入环境变量os.environ['DEEPL_API_KEY']。预期:JSON响应包含翻译统计。代码:

import requests

import os

def deepl_translate(text, target='ZH'):

url = 'https://api-free.deepl.com/v2/translate'

params = {

'auth_key': os.getenv('DEEPL_API_KEY'),

'text': text,

'source_lang': 'EN',

'target_lang': target

}

response = requests.post(url, data=params)

return response.json()['translations'][0]['text']

# PDF提取后调用免费版限500k字符/月,升级或轮换密钥。调试时,如果翻译卡住,检查配额。混合脚本能更好地捕捉俚语,如“glitch”译为“故障”。局限性:手写PDF的OCR率仅70%;机密文件云上传风险高,2026欧盟AI法案要求披露数据处理细节。不适合实时口译,延迟0.5秒可能丢失情感 nuance;创意写作的风格往往平淡,2024测试中情节连贯但原创性弱。法律翻译错误率15%,始终需人工复核。教育应用如Coursera 2026课程讲义翻译,理解度升40%,但需警惕偏见如性别词处理偏差。商业场景如阿里巴巴产品描述英中翻译,销量增25%,但文化差异易导致误解。原理:Transformer的注意力机制用Q*K^T / sqrt(d_k)计算,关注句子依赖。到2026年,模型参数超1万亿,如Grok-3变体加速PDF并行计算。工具对比:Google免费适合日常,DeepL 8.99欧元更自然,AWS 0.004美元/千字支持自定义;Google数据丰富,AWS企业级强。边界:多语言文件需预分类,否则检测错误率升至15%。

步骤7:本地AI翻译设置

import fitz

from transformers import pipeline

import torch

translator = pipeline('translation', model='Helsinki-NLP/opus-mt-en-zh', device=0 if torch.cuda.is_available() else -1)

def local_translate_pdf(pdf_path):

doc = fitz.open(pdf_path)

full_text = ''

for page in doc:

full_text += page.get_text() + '\n'

chunks = [full_text[i:i+1000] for i in range(0, len(full_text), 1000)]

translated = []

for chunk in chunks:

result = translator(chunk, max_length=1000)

translated.append(result[0]['translation_text'])

return '\n'.join(translated)

# with open('output.txt', 'w', encoding='utf-8') as f: f.write(result)输出为TXT,无需网络连接。内存溢出时,减小chunk大小或切换CPU模式。测试技术PDF准确率85%,无隐私担忧。加载时间长,可用cachedir加速。开源模型更新较慢,不如云服务及时。游戏开发中,2026 Reddit讨论显示,本地化节省预算,但需校对文化元素如“wa”译为“和谐”。伦理考虑:2026 UNESCO指南要求避免偏见,2025研究显示中英性别偏见率8%,建议用多样数据集清洗。未来:2026年底CLIP多模态模型能理解视觉上下文。风险:本地硬件不足可能导致崩溃;模型过时,准确率落后云服务5-10%。边界:仅限英文-中文对,其他语言需更换模型。

步骤8:优化批量处理工作流以提升效率

批量PDF翻译常遇瓶颈,如文件拆分和并行处理。到2026年,结合脚本和工具可自动化整个流程,节省时间。依据2025年Python翻译库基准测试,优化后效率升50%。推理:从OCR到审校的串联脚本减少手动干预。结论:适合处理上百文件,但需监控资源消耗。风险:脚本错误可能导致数据丢失,先备份原文件。建议从小批量验证:准备10个PDF,运行端到端测试。

路径:用Airflow 2026版(开源,pip install apache-airflow)构建DAG工作流。设置任务顺序:OCR(步骤1)> 翻译(步骤2或5)> 审校脚本(步骤3)。参数:schedule_interval='@daily',用于定时批量;dependencies=[ocr_task >> translate_task]。上传到云如AWS EC2免费层(t2.micro实例,12个月免费)。问题:依赖安装可能冲突。解决:用Docker容器化(docker pull apache/airflow),确保环境一致。预期:DAG运行后,输出文件夹包含所有翻译DOCX,日志记录错误率。代码片段(Airflow DAG):

from airflow import DAG

from airflow.operators.python import PythonOperator

from datetime import datetime

def run_ocr(**context):

# 调用步骤1 OCR函数

pass

def run_translate(**context):

# 调用Google或AWS翻译

pass

dag = DAG('pdf_translation', start_date=datetime(2026,1,1), schedule_interval='@daily')

ocr_task = PythonOperator(task_id='ocr', python_callable=run_ocr, dag=dag)

translate_task = PythonOperator(task_id='translate', python_callable=run_translate, dag=dag)

ocr_task >> translate_task这个DAG处理目录中所有PDF,预期1小时内完成50文件。边界:免费EC2有时间限制,超支转为付费(0.01美元/小时)。不适合实时任务,更适合夜间运行。测试中,技术报告批量处理一致性高,但复杂布局如图表需额外工具如pdf2john恢复。风险:自动化链路中断时,需手动恢复;资源峰值可能超出免费限额。

步骤9:评估翻译质量并迭代改进

路径:安装sacrebleu库(pip install sacrebleu),比较源译文。参数:bleu = corpus_bleu([refs], [sys]),refs为参考译文,sys为AI输出。针对PDF,提取文本后运行。对于无参考场景,用置信度或人工checklist:术语一致(20%权重)、流畅度(30%)、文化适应(50%)。问题:BLEU低估文学文本。解决:结合人类评估,邀请2-3人评分(工具如Appen平台,每份5美元)。预期:分数报告指导迭代,如低分段重训自定义模型。代码示例:

from sacrebleu import corpus_bleu

refs = [['参考译文1'], ['参考译文2']] # 多参考

sys = ['AI译文']

score = corpus_bleu(sys, refs)

print(score.score) # 输出BLEU分数迭代:如果分数<85%,fine-tune Hugging Face模型(步骤7),用领域数据如2025年开源技术语料(10GB)。边界:fine-tune需GPU,耗时1-2小时/模型。不适合小样本,至少需1000句对。行业数据:2026年企业报告显示,迭代后法律PDF错误降12%。教育中,迭代翻译讲义后学生满意度升35%。局限性:AI偏见持久,如2025研究中文化刻板印象率10%,需多样数据清洗。原理扩展:用BertViz工具(pip install bertviz)可视化注意力,帮助调试依赖错误。风险:迭代过程数据不足,可能引入新偏差。

步骤10:安全与合规模块翻译实践

安全是批量翻译的底线,2026年法规如GDPR和CCPA要求数据加密和用户同意。依据2026年Cloud Security Alliance的安全审计,未加密上传的泄露风险高20%。推理:端到端加密确保传输安全。结论:采用加密工作流将风险降至1%。风险:云服务数据驻留可能涉及跨境传输违规;免费工具常记录用户文件日志。

路径:用VeraCrypt免费加密本地PDF(veracrypt.fr,创建容器),上传前解密。云端选AWS KMS(密钥管理,每月1美元起)加密S3桶。参数:启用server-side encryption,政策deny未加密上传。对于合规,记录审计日志:谁翻译、何时、置信度。问题:加密会减速10%。解决:用硬件加速如TPM模块。预期:生成合规报告,适合企业分享。代码:在boto3的put_object中添加Encryption='aws:kms'。边界:开源工具如GPG(gpg --encrypt file.pdf)免费,但学习曲线陡峭。不适合高频访问,解密有延时。案例:2026年医疗PDF翻译,用加密后通过欧盟检查,避免罚款。游戏行业,加密脚本本地化防IP泄露。伦理提醒:避免AI放大偏见,2026 UNESCO要求透明标注AI生成内容。未来:2027年联邦学习模型支持本地训练,无需上传数据。行动:为你的PDF添加加密层,测试步骤8-9的完整流程,记录质量分数。若有专业需求,咨询译员结合使用。加入开源社区,贡献自定义术语,推动工具进步。

步骤11:处理特殊PDF类型,如包含图像或公式的文档

许多PDF不止纯文本,还包括图像、图表或数学公式,这些会挑战AI翻译的完整性。到2026年,专用工具能提取并翻译这些部分,但需多步操作。依据2025年CVPR会议的多模态翻译报告,标准AI忽略图像上下文,导致整体准确率降至75%。推理:先分离元素,再独立翻译,最后重组。结论:这提升复杂文档可用性,但时间增加20-30%。

路径:用pdfplumber库(pip install pdfplumber)提取文本和图像。代码示例:

import pdfplumber

with pdfplumber.open('input.pdf') as pdf:

for page in pdf.pages:

text = page.extract_text()

images = page.images

# 翻译text

# 对于图像,用OCR如Tesseract处理

for img in images:

# 保存img并OCR

pass对于公式,用Mathpix API(2026免费每月50页,Pro 9.99美元/月)转换LaTeX。上传截图,输出可编辑公式。依据测试,其识别率95%,优于内置工具。风险:图像OCR受分辨率影响,低清文件错误率升至40%。边界:手绘公式不支持,需人工转录。不适合艺术PDF,颜色和布局易丢失。预期:输出新DOCX,含翻译文本、图像说明和公式。审校重点:图像描述是否匹配上下文,如技术图表标签翻译一致。局限性:多模态AI如2026 GPT-4o变体能直接处理,但API费用高,每页0.05美元。建议从小文档测试,验证重组后格式。

步骤12:成本优化与免费工具组合策略

批量翻译费用易累积,尤其企业使用。到2026年,混合免费和付费工具可将成本降至原先60%。依据2026年Gartner翻译经济分析,免费限额利用率低常导致浪费。推理:优先免费处理简单文件,付费针对高价值任务。结论:这样平衡质量和预算,但需跟踪使用量。

路径:Google免费处理日常PDF,DeepL免费版限文学片段,AWS免费层起步。组合脚本监控限额:用Python requests检查API配额。示例:if remaining_quota < 1000: switch_to_google()。免费OCR用Tesseract本地(pip install pytesseract),准确率85%,无需上传。风险:免费工具限速,批量时延时翻倍;切换频繁易出错。边界:月处理超1000页,免费组合不足,转付费。预期:年成本控制在50美元内,适合个人。专业场景,谈判企业折扣如Azure批量协议。局限性:免费版不支持自定义术语,一致性差5%。行动:列出文件类型,分配工具,运行成本模拟脚本。

步骤13:未来趋势与工具更新监控

AI翻译正向多模态和个性化发展,2027年量子辅助模型可能将准确率推至98%。当前,监控更新至关重要,如Hugging Face每周新模型。依据2026年MIT Technology Review的AI展望,边缘计算将普及本地翻译。推理:及早采用新工具,避免过时。结论:定期检查提升长期效率,但需测试兼容性。

路径:订阅Machine Translation Weekly newsletter,GitHub star相关repo。用Google Alerts设置关键词“AI翻译更新2026”。风险:更新可能破坏旧脚本,需Git版本控制。边界:开源模型迭代快,云服务稳定但收费可能上涨。预期:每季度审视,升级1-2工具。局限性:趋势预测不确定,勿过度投资。建议:从步骤1实践你的PDF,记录经验,分享到论坛获取反馈。

步骤14:常见错误排除与故障诊断

批量PDF翻译中,常见错误包括格式崩溃、翻译不准或上传失败。到2026年,系统性诊断能快速定位问题。依据2025年AI工具故障报告(来源:Stack Overflow分析),80%的错误源于输入不兼容或网络问题。推理:通过日志检查和逐步验证,隔离故障源。结论:这能将调试时间缩短50%,但需基本技术知识。

路径:翻译失败时,先检查日志,如Google Translate的错误码(例如“quotaExceeded”表示超限)。用Chrome开发者工具(F12 > Network)监控上传状态。如果格式乱,用pdfinfo命令(安装poppler-utils)验证PDF版本,确保兼容ISO 32000-2。OCR错误常见于低分辨率扫描,解决:用ImageMagick调整图像(convert input.jpg -density 300 output.jpg)。代码示例诊断脚本(Python):

import PyPDF2

def diagnose_pdf(file_path):

try:

with open(file_path, 'rb') as f:

reader = PyPDF2.PdfReader(f)

if '/Type' not in reader.trailer:

print('PDF损坏,尝试修复用qpdf --linearize input.pdf')

pages = len(reader.pages)

print(f'页数: {pages}')

# 检查文本提取

text = reader.pages[0].extract_text()

if len(text.strip()) < 10:

print('文本提取失败,可能需OCR')

except Exception as e:

print(f'错误: {e}')

# 使用:diagnose_pdf('input.pdf')预期:脚本输出问题提示,指导修复。风险:复杂PDF诊断需专业软件如Ghostscript,免费但命令行操作繁琐。边界:加密PDF无法直接诊断,先解密。测试中,修复后翻译成功率升至95%。局限性:网络故障无法本地解决,需备用工具如本地模型(步骤7)。行动:为每个步骤添加诊断检查,构建故障排除清单。

步骤15:文化与领域特定适应

AI翻译常忽略文化细微差别,尤其在专业领域。到2026年,自定义训练能提升适应性。依据2025年跨文化翻译研究(来源:Wiley期刊),通用模型的文化错误率达15%。推理:用领域语料fine-tune模型,注入本地化规则。结论:这使输出更贴合语境,但增加初始设置时间。

路径:对于医疗PDF,用PubMed 2025语料fine-tune mBART(Hugging Face数据集)。设置:from transformers import Trainer; trainer.train(), epochs=3,学习率1e-5。法律领域,添加术语库如“tort”统一译为“侵权”。测试:比较前后版本,文化适应分数从70%升至90%。风险:fine-tune数据不足可能加剧偏见,如忽略区域习俗。边界:创意领域如广告,AI捕捉率仅60%,需人工重写。不适合动态内容,模型更新滞后。预期:适应后,商业PDF如产品手册,用户反馈满意度升25%。伦理:确保训练数据多样,避免地域偏见。建议:针对你的领域收集1000+样本,运行fine-tune测试。

步骤16:性能基准与A/B测试

选择工具前,进行性能基准测试至关重要。到2026年,A/B测试能量化差异。依据2026年基准框架(来源:arXiv论文),速度与准确的权衡是关键。推理:用相同文件集比较工具,计算指标如翻译时间和BLEU分数。结论:这帮助选出最佳组合,但需标准化测试环境。

路径:准备10个样本文档(技术、文学各半),用脚本运行Google vs DeepL。指标:时间(秒/页)、准确(BLEU>0.85)、成本(美元/1000字)。代码框架:

import time

def benchmark_translate(tool, file):

start = time.time()

result = tool.translate(file)

end = time.time()

return {'time': end - start, 'output': result}

# 比较:google_result = benchmark_translate(google_translator, pdf)预期:报告显示DeepL在文学上胜出,Google速度更快。风险:测试样本偏差可能误导,选择代表性文件。边界:大文件测试需云资源,避免本地瓶颈。局限性:A/B忽略主观因素,如可读性,结合人工评分。行动:运行你的基准,调整工作流。

步骤17:集成到现有工作流程

将AI翻译融入日常工具链,能无缝提升生产力。到2026年,API集成是主流。依据2025年工作流优化报告(来源:Forrester),集成后效率升40%。推理:用插件或脚本连接如Office 365。结论:这减少切换成本,但需API密钥管理。

路径:InDesign 2026插件支持DeepL API,路径:插件市场搜索“Translate”,设置密钥。自动化:Zapier免费版连接Google Drive到Translate,每新PDF触发翻译。风险:API中断影响链路,设置重试机制。边界:遗留系统兼容差,需中间件。预期:端到端自动化,处理50文件/天。建议:映射你的工具,测试集成。

步骤18:社区资源与持续学习

保持更新需借助社区。到2026年,论坛和课程是主要来源。依据2026年学习路径分析(来源:Coursera数据),参与社区用户技能升30%。推理:分享经验换取反馈,加速问题解决。结论:这构建知识网络,但需辨别可靠信息。

路径:加入Reddit r/MachineTranslation,提问如“2026 PDF批量最佳实践”。课程:edX的“AI翻译基础”免费模块。风险:误导信息泛滥,交叉验证来源。边界:付费社区如LinkedIn群更专业。预期:每月学一新技巧。行动:订阅2-3资源,应用到项目。

为你的批量PDF翻译启动,从步骤1准备文件,逐步执行到评估。记录每个步骤的输出,调整以匹配需求。如果遇到特定错误,参考步骤14诊断。最终,结合人工审校,确保输出可靠。

AI翻译PDF时格式是否会丢失?

是的,AI工具如Google Translate可能导致表格或图像偏移,但通过Word审校和布局调整可恢复90%的结构。建议预处理复杂PDF。

免费工具的限额如何管理?

使用脚本监控配额,如Google每月10文件,结合DeepL免费版处理小任务。超出时切换到AWS免费层,避免中断。

本地翻译是否适合企业使用?

适合隐私敏感场景,但需强大硬件如RTX 40系列GPU。准确率达85%,无云费用,但速度慢于云服务。