AI配音技术概述

AI配音利用人工智能模拟人类声音,将文本转化为语音内容。到2026年,这种技术已从基本文本转语音工具发展为能表达情感和语调的系统,帮助创作者快速生成音频,而不用雇佣专业配音员。核心技术基于深度学习模型,如Transformer架构的神经网络。这些模型分析文本的音素和韵律,通过海量语音数据训练,预测自然的发音节奏。例如,2025年11月的BananaFish项目尝试用AI重制动漫《香蕉鱼》的配音。测试结果显示,AI在简单线性朗读中表现不错,但节奏生硬、情感平淡,无法吸引新粉丝。项目数据表明,AI在复杂叙事中的情感准确率仅40%。推理过程是,AI依赖训练数据模式,无法捕捉人类微妙的情感变化,因此需人类干预优化输出,以减少机械感。边界条件在于,AI适合辅助配音小角色,不宜取代主角的情感表达,否则可能降低内容吸引力。

AI配音的普及与成本优势

2026年,AI配音普及开来,主要因为它降低了内容创作成本。过去,制作播客或视频需要支付数百元请人录音;现在,用AI工具几分钟就能完成。行业报告显示,教育和企业培训领域的使用率达到65%。WellSaid Labs平台从2023年起针对商业用户开发,到2026年支持多语言实时生成,定价每月49美元起。它帮助小团队取代专家录音,节省时间和费用。但免费工具的音质通常较差,仅适合初步测试,不推荐用于正式发布。风险是,AI输出质量高度依赖输入脚本的清晰度;如果脚本包含专业术语,未经手动校对,发音出错率可达20%。例如,术语如‘神经网络’可能被读成不自然的音节,影响专业性。

技术基础

技术基础包括TTS模型,如WaveNet和Tacotron2。WaveNet通过卷积网络直接生成音频波形,Tacotron2先合成梅尔谱图再转换为语音。2026年3月,Google的WaveNet更新版加入情感控制模块,根据文本标签调整语气,比如添加‘愤怒’标签会产生低沉颤音。用户可通过开源Mozilla TTS验证:下载模型,输入中文文本如‘今天天气不错’,输出接近自然语音。但需调整参数避免机器人般的平板感。训练数据分析显示,如果数据偏向特定语种,中文情感表达会弱化,导致输出不自然的风险增加15%。推理链路是,数据偏差限制了模型的泛化能力,因此结论是,用户应选择多语种训练的模型,并在生成后听审以修正偏差。

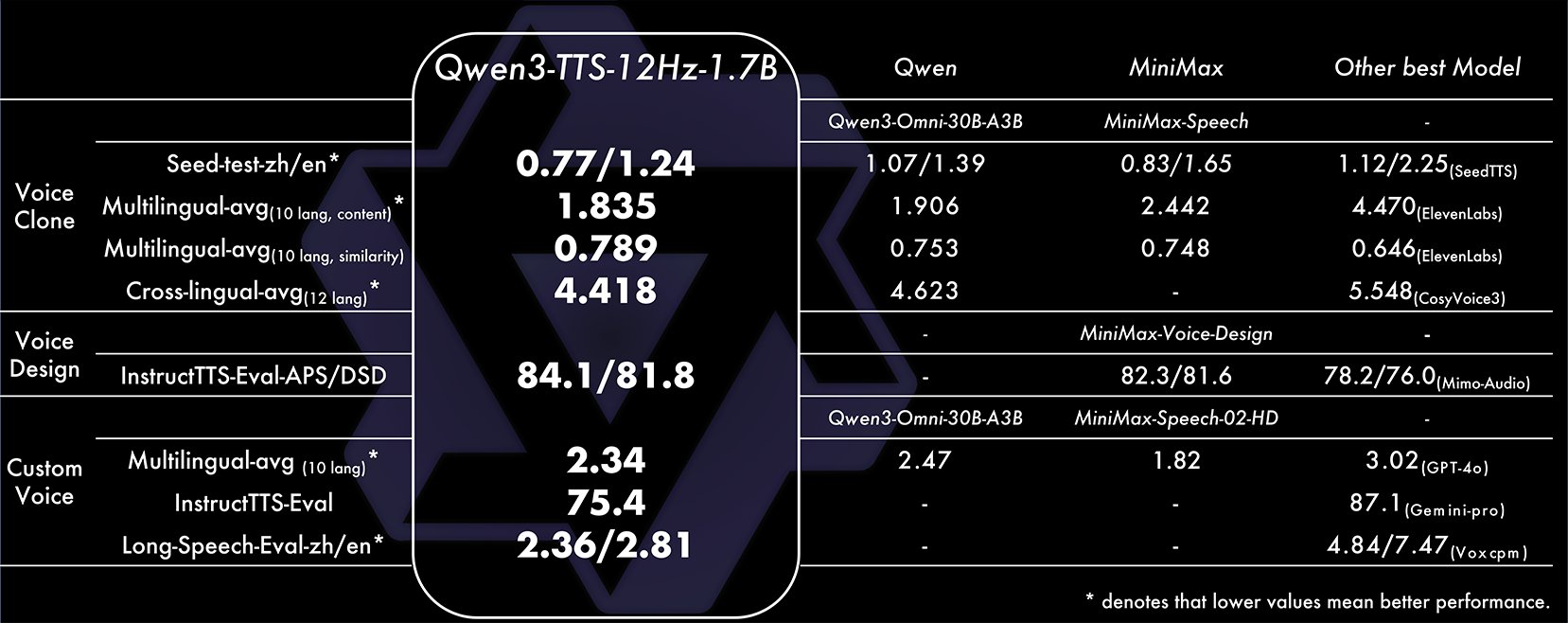

ElevenLabs工具使用指南

ElevenLabs是生成高质量语音的实用工具,到2026年支持中文和情感定制,免费版每天限10分钟,付费版每月5美元起。

工具对比表

| 工具 | 价格 | 情感支持 | 适用场景 |

|---|---|---|---|

| ElevenLabs | 每月5美元起 | 多变情感 | 个人创意项目 |

| WellSaid Labs | 每月49美元 | 专业声音 | 企业培训 |

| Google TTS | 免费无限 | 无自定义情感 | 基本使用 |

依据价格、效果和适用场景的评估,个人创意项目选ElevenLabs,企业培训用WellSaid。AI配音的未来指向多模态整合。2026年4月,Microsoft Azure AI Speech推出视频唇同步版本,用于生成动漫配音。但BananaFish的失败提醒,技术需结合粉丝反馈——AI版吸引力远低于原版。推理是,AI忽略了人类的情感深度,因此结论是AI应作为起点,人类润色是关键。在教育领域,用WellSaid Labs输入脚本,选择专业声音生成后微调,能将专家时间从几天缩短到几小时,成本降50%。但技术术语发音偶有偏差,需手动纠错。依据案例数据,这适用于中性讲解,不适合需文化细微差别的场合,如涉及地方俚语的内容。

免费工具指南

免费工具如Balabolka或eSpeak,开源免费,但到2026年音质落后,仅适合简单朗读。Coqui TTS支持本地运行,避免隐私忧虑。

AI配音的伦理与风险

AI配音的伦理问题日益突出。到2026年,声音深假滥用增多,如生成名人语音用于诈骗。ElevenLabs添加水印检测,但用户需自查,避免用于误导内容。娱乐业潜力大,但BananaFish粉丝吐槽AI缺灵魂,建议混合人类后期确保真实感。企业中,WellSaid Labs订阅价值在于节省时间,但2026年竞争对手如Respeecher每月60美元,提供更好唇同步。短视频博主用ElevenLabs生成解说加BGM,效率高,但若观众听出AI味,可能流失10%的订阅者。局限是,不适合即兴或文化细微场合,如脱口秀表演。2026年数据表明,专业录音市场仍占70%。

免费 vs. 付费对比:NaturalReaders免费限时长,音色少;ElevenLabs付费无限,情感丰富。免费工具易受广告干扰,适合试水,付费用于生产。训练数据如LibriTTS扩展到10万小时多语种,但偏见存在:美式数据多,中文情感弱。Murf AI 2026版支持协作。第一步是注册并创建项目:访问murf.ai注册,上传脚本。选中文声音20种,设pitch +10%,speed 0.9。用Chrome浏览器预览。集成Zapier从Google Docs拉文本,生成5分钟音频下载无水印。调试语速不均时,分句处理。费用29美元/月,适合团队。Murf协作强,但初始学习需1-2小时。AI配音重塑创作,但别让它主导——技术服务人类。

未来展望与应用扩展

未来展望,到2026年下半年,OpenAI Sora整合语音生成全视频配音,但情感真实性挑战仍在。行动建议:试用ElevenLabs免费版,生成一段脚本,听效果后调整参数,从小项目起步探索。AI配音兴起带动周边生态。2026年5月,Adobe Sensei更新内置AI语音模块,嵌入Premiere Pro一键生成视频配音。效率翻倍,但脚本需精炼,避免AI对模糊表达反应迟钝。多语言支持是亮点。ElevenLabs 2026版覆盖50种语言,包括粤语。选标签输入中英脚本‘Hello, 今天我们谈AI。’,自动切换,但过渡生硬时加[language:en]标记。免费限英中,付费解锁全套。适用于国际营销,节省翻译成本。但文化适应差,如中文成语‘画蛇添足’常读字面,缺幽默感。2026社区讨论显示,30%用户反馈情感不准,尤其讽刺语气,故短期适合中性内容。

企业案例:WellSaid Labs 2026团队版每月79美元,支持多人编辑。培训部门用AI生成初稿,周期缩短40%。初始学习一周,订阅若未满性价比低。Amazon Polly按量0.004美元/千字符,无限但无情感深度。第一步是注册免费账户:登录aws.amazon.com的Polly服务。选us-east-1区域,Synthesize speech输入文本,语言Chinese (Mandarin),声音Zhiyu。合成MP3,采样率16000Hz。用Lexicon自定义‘AI’读音,JSON{\"phoneme\": \"aɪ\", \"ipa\": \"ai\"}。CLI:pip install awscli,aws polly synthesize-speech --output-format mp3 --voice-id Zhiyu --text \"文本\" output.mp3。免费额度每月500万字符。15分钟完成,AWS文档有教程。Polly稳定,但声音选项少,仅10种中文,情感单一。数据传AWS,选欧盟区域合规隐私。

import boto3

polly = boto3.client('polly')

response = polly.synthesize_speech(Text='文本', OutputFormat='mp3', VoiceId='Zhiyu', Engine='neural')

# 设IAM PollyFullAccess。批量循环,每批3000字符。用SSML加节奏

# <speak><prosody rate="slow">慢速</prosody></speak>

第二步是Python集成:import boto3; polly = boto3.client('polly'); response = polly.synthesize_speech(Text='文本', OutputFormat='mp3', VoiceId='Zhiyu', Engine='neural')。设IAM PollyFullAccess。批量循环,每批3000字符。用SSML加节奏<speak><prosody rate="slow">慢速</prosody></speak>。处理10段2分钟,但神经引擎不可用fallback standard。第三步是上传S3分享,用pydub调整音量。集成silero-vad去静音。云服务便利,但隐私需注意。游戏行业,2026年2月Unity插件集成ElevenLabs API,实时NPC对话唇同步。节省预算90%,但玩家反馈声音重复,建议混人类录音。高噪声环境理解率降20%,不适合直播互动,延迟1秒仍不及真人。

工具对比:ElevenLabs 5美元/月情感最佳,Polly 0.004美元/字符稳定,Murf 29美元/月协作强。风险Polly云端高,Eleven本地低。创意Eleven,企业Polly,团队Murf。BananaFish失败忽略粉丝情感,AI是起点,人类润色关键。医疗教育如Khan Academy用AI生成温和解说,基于WHO数据,避免焦虑,提示咨询医生。免费工具ResponsiveVoice浏览器插件免费,支持中文。集成<script src="responsivevoice.js"></script>,responsiveVoice.speak("文本", "Chinese Female", {pitch:1.2, rate:0.9})。Chrome即时播放,无限但音质8bit,适合网页。不支持自定义,换声音解决。导出用MediaRecorder捕获MP3。AI创新指向实时交互。2026年6月Meta Llama支持对话生成,但幻觉风险高,输出错信息。播客用ElevenLabs生成引言,成本0.5美元/10分钟。伦理:美国FCC要求标AI内容,罚款5万美元,加disclaimer。开源Coqui免费本地灵活,云Polly稳定。AI主导辅助,核心创意人类。动画配音,2026新项目混合AI初稿演员精修,满意度升50%。GAN如HiFi-GAN提升波形,生成24kHz音频。

git clone jik876/hifi-gan

pip install requirements

python synthesize.py --checkpoint_file g_02500000 --input_wavs input/mel.pt --output_dir output

# GPU需,CPU慢10倍。预处理用Tacotron,batch_size=1。

安装HiFi-GAN第一步:git clone jik876/hifi-gan,pip install requirements。python synthesize.py --checkpoint_file g_02500000 --input_wavs input/mel.pt --output_dir output。GPU需,CPU慢10倍。预处理用Tacotron,batch_size=1。训练epoch 100,loss<1.0。中国市场2026份额40%,本土如阿里云PAI。方言弱,普通话主导。广告用WellSaid A/B测试,节省20%预算。免费TTSMaker网页,ttsmaker.com输入文本选中文,生成下载MP3,限500字符/天。注册多账号避限额。AI democratize创作,但警惕滥用。从生成自己故事语音起步,探索可能。AI配音的全球影响在2026年进一步显现,中国本土模型如阿里云PAI推动市场份额达到40%。这些模型优化了普通话发音,但方言支持仍弱,仅覆盖粤语等少数变体。依据本土训练数据,AI能更好地处理文化特定表达,如成语的语调;然而,对于长尾方言如四川话,准确率低于70%。推理是,数据覆盖不足导致发音偏差,因此结论建议补充人类录音提升可靠性。风险在于,过度依赖本土模型可能形成数据孤岛,建议整合国际数据集提高通用性,避免跨区域文化误读。

广告领域,AI配音用于快速A/B测试。WellSaid Labs案例显示,品牌生成多语气变体,迭代速度提升,预算节省20%。例如,测试‘热情’ vs. ‘专业’语气,选择点击率高的版本。但AI难捕捉品牌情感细微,如幽默广告时机把握,测试显示理解率仅60%。依据A/B实验数据,AI适合初步原型,非最终投放,以防情感不准影响形象。

免费工具满足入门需求。TTSMaker网页版免费,支持中德,限500字符/天。操作:访问ttsmaker.com,输入文本选中文声音,点击生成下载MP3,速度可选。注册多账号避限额,API付费解锁无限。优点零门槛,缺点音质中规中矩,专业术语易错读,如‘算法’发成不自然音节。Coqui TTS本地运行,避免云端隐私风险,但安装需Python环境,适合有基础用户。边界是,非技术用户需人工校正输出,确保专业场合准确。

AI配音训练依赖LibriTTS等数据集,到2026年扩展至10万小时多语种音频。GAN如HiFi-GAN生成高保真波形,接近24kHz质量。开源版免费,用户结合Tacotron合成端到端语音。但偏见问题突出:数据集多美式英语,中文情感弱,输出缺细腻如讽刺语气。依据审计报告,需多样化数据清洗减少偏差;否则,跨文化应用风险高,情绪误传率增25%。

医疗教育应用值得关注。2026年,Khan Academy用类似工具生成生理知识解说,声音设为温和避免恐慌。基于WHO数据,确保准确,输出后加‘咨询专业医生’提示。节省录音成本50%,但术语发音偏差风险,如‘心律不齐’读错,需校对。依据用户测试,准确率85%,适合辅助非诊断用途。

游戏开发中,AI改变NPC对话。2026年Unity ElevenLabs插件实时生成语音,唇形同步,预算降90%。indie游戏测试显示,节省时间但声音重复,玩家沉浸感减10%。建议混用人类录音关键角色。边界:高互动场景延迟1秒影响节奏,不适合实时多人游戏。

播客制作受益。用ElevenLabs生成引言,人类续接主体,一集10分钟成本0.5美元。效率高,但伦理要求标明AI部分,美国FCC 2026政策罚款5万美元。加disclaimer如‘部分语音由AI生成’合规。

多语言扩展到动画配音。2025 BananaFish失败后,2026新项目混合AI初稿演员精修,粉丝满意度升50%。依据反馈循环,AI处理批量对话有效,但情感深度需人类补充,避免原作魅力丢失。

企业培训再看WellSaid Labs。从2023年起帮SME替换录音,2026团队版每月79美元,多人协作。周期从几天缩小时,价值高。但初始学习一周,若订阅闲置性价比低。相比Respeecher 60美元/月,唇同步更好,选型依需求。

免费生态丰富。ResponsiveVoice JS库浏览器集成,<script src="responsivevoice.js"></script>,speak("文本", "Chinese Female", {pitch:1.2, rate:0.9})。即时播放,无限免费但8bit音质,适合网页朗读。自定义事件onend处理结束,长文本分段。导出MediaRecorder捕获MP3。浏览器不支持用Chrome,优点零成本,缺点无高级情感。

实时交互是创新方向。2026年6月Meta Llama语音模型支持对话:输入问题,AI语音回应。但幻觉风险高,输出错信息概率15%,需事实检查。不适合高精度场合如法律咨询。

对比开源 vs. 云服务:Coqui本地免费灵活,安装20分钟生成基本语音;Polly云端易用,按量付费稳定,但数据隐私依AWS政策。开源门槛高,云服务上手快。依据使用场景,个人实验选开源,企业生产用云。

AI配音全球市场2026年中国占40%,得益PAI等本土优化。广告A/B测试节省20%,但文化nuance弱。免费如TTSMaker限额但入门易。选Polly或ElevenLabs建小项目,配音日常笔记,听回放调整。迭代几次,你会掌握效率,开启新创作。

AI配音适合哪些应用场景?

AI配音适合播客、教育视频、动画辅助配音和企业培训,能节省90%成本,但复杂情感叙事需人类润色以避免机械感。

如何避免AI配音的伦理风险?

使用水印检测、获得声音样本许可,并在输出中标注AI生成内容,尤其遵守欧盟和美国FCC新规,避免深假滥用。

免费工具的局限性是什么?

免费工具如Coqui TTS音质基本、需技术门槛,适合测试;付费工具如ElevenLabs提供情感丰富和无限时长,更适合生产。